Las últimas tres semanas han sido particularmente ricas en reflexiones en torno a la Inteligencia Artificial Generativa (IAG), su desarrollo y sus implicaciones educativas y sociales. Por un lado, la feroz competencia entre empresas y países por el liderazgo en la investigación, desarrollo, comercialización y uso de la IAG hace que la evolución de la IAG se parezca al famoso tren sin piloto que avanza cada vez más rápido en la película Imparable (Unstoppable) — por cierto, basada en un hecho real.

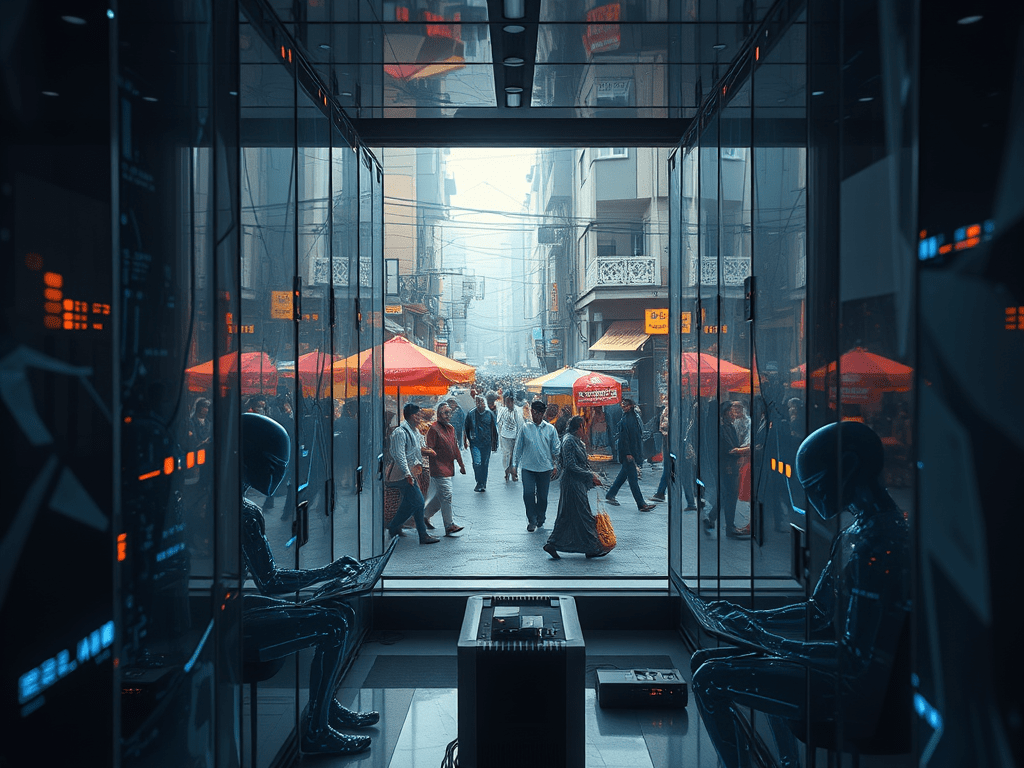

Se ha comentado mucho que uno de los mayores problemas de la IAG es que no conoce el mundo ni su mera existencia, solamente lo que se dice sobre él, de modo que una de las rutas de desarrollo más importantes para la IAG es darle acceso al mundo, ya sea a través de robots que se muevan en los espacios físicos y aprendan de ellos o a través de agentes, o sistemas de IAG que se pueden conectar al mundo digital y producir secuencias de acciones además de contenidos, como es el caso del famoso Openclaw.

Otra de las líneas de desarrollo más importantes para la AIG hoy en día es la programación automática. Mientras al inicio se trataba solamente de “completar el código”, infiriendo las instrucciones que siguen a continuación a partir de las escritas previamente —el objetivo inicial de Github Copilot, de Microsoft— evolucionó a lo que se conoce como vibe coding, donde la mayor parte de la programación la hace la IAG, y actualmente a agentes de IAG como Claude Code y OpenAI Codex, capaces de programa aplicaciones y sistemas completos a partir de las indicaciones del desarrollador de software. En comparación con abrir la puerta del mundo a la IAG, la programación automática abre la puerta hacia el interior de la IAG, habilitándola potencialmente para programarse a sí misma.

En el templo de Mission Bay [sede de OpenAI], nadie necesita que le den consejos sobre Codex. Muchos ingenieros de OpenAI con los que hablé dijeron que ya casi no escriben código. Simplemente pasan el día hablando de Codex. Y a veces se reúnen y lo hacen en congregación [Maxwell Zeff, 2026-03-11].

Así como soltar herramientas de IAG al público en general con pocas o nulas restricciones está trastornado diversos ámbitos de la sociedad —como es el caso particular de los sistemas educativos basados en la exposición del docente y la evaluación de productos que los alumnos construyen mediante procesos que hoy en día son automatizables con IAG— soltar la IAG a interactuar libremente con un mundo que desconoce puede traer consecuencias graves para los individuos y la sociedad, porque la información que recibirá suele ser difícil de predecir y la interpretación que hará de ella todavía más. Algunos ejemplos reportados en la literatura incluyen agentes de IAG que se empecinan en que su cliente se deshaga de lo que ya tiene para comprar lo no quiere ni necesita, o bien reaccionan “airadamente” cuando otras personas no los dejen hacer lo que quieren. Asimismo, en una sociedad que depende cada día más críticamente de la ejecución de software, ya sea usado por una cantidad masiva de personas (como en los teléfonos celulares) o empleado para gestionar recursos valiosos o atender procesos críticos, delegar a agentes que de vez en cuando “alucinan” la responsabilidad de desarrollarlo implica un gran riesgo y las consecuencias pueden ser graves, como ha ocurrido ya con la producción automática de documentos.

Aún incluso funcionando bien, las consecuencias de usar agentes de IAG pueden ser negativas. En el contexto de la educación, donde tenemos ya suficientes problemas para distinguir lo que el estudiante hace y lo que copia y pega de lo generado por la IAG, los agentes pueden reducir aún más el hacer de los estudiantes, automatizando el proceso de leer las instrucciones de la tarea (en el documento que bajó el estudiante, en el mensaje de correo electrónico enviado por el docente, en la plataforma educativa) buscar información en la Web, revisar trabajos previos del estudiante (en la computadora o en la nube), generar un nuevo producto coherente con lo producido previamente y enviarlo acompañado de un bonito texto que ablande el corazón del docente —todo ello mientras el estudiante dedica su tiempo a hacer lo que más le gusta. En el ámbito del desarrollo de software, las nuevas generaciones de programadores e ingenieros de software están riesgo de no encontrar trabajo ante la competencia de agentes de IAG como los arriba mencionados que, además, son incansables y cobran menos de $100 dólares al mes.

Como cualquier otra tecnología poderosa que haya desarrollado la humanidad, la IAG tiene dos filos: sabiéndola usar bien y en beneficio propio y de la organización social en la que nos ubiquemos, puede magnificar nuestras capacidades de comprender el mundo y crear para bien; pero no sabiéndola usar, o hacerlo con malas intenciones, puede provocar grandes daños. Entre estos dos extremos se abre un abanico infinito de posibilidades, de matices, que invalidan posturas extremas como la prohibición y estigmatización de la IAG (en el ámbito académico, por ejemplo) y su desarrollo y comercialización sin restricciones por las grandes empresas tecnológicas.

La curva de las expectativas infladas de Gardner, comprobada una y otra vez en el ámbito tecnológico, nos sugiere que estamos en la cúspide de las expectativas infladas sobre la IAG. Esto es, que la tecnología que hoy en día nos sorprende y nos da dolores de cabeza, basada en cantidades gigantescas de energía para dar soporte a capacidades gigantescas de procesamiento aplicadas a cantidades gigantescas de datos, seguirá avanzando algunos años pero encontraremos sus limitaciones —como su incapacidad para dejar de “alucinar”— y entonces, al tiempo que la burbuja explotará y se perderán cantidades gigantescas (también) de dinero, la inteligencia artificial, en sus distintas variantes, pasará a ser parte esencial de nuestras vidas, en beneficio de algunos y en perjuicio de muchos más, replicando y aumentando las desigualdades en nuestras sociedades.

Deja un comentario